模型配置

产品内置主流大模型,覆盖推理、多模态及图像处理能力。自定义模型可通过可视化界面配置,支持添加、编辑和删除模型,无需手动编辑配置文件。

自动模式

自动模式启用后,WorkBuddy将根据任务自动选择适合的模型。

内置模型

| 模型名称 | 简介 | 可用功能 |

|---|---|---|

| Auto | 平衡效果与速度 | √ 图片输入 |

| Hy3 preview | 混元思考模型,具有增强的推理能力 | √ 图片输入 √ 推理模型 |

| GLM-5.0 | 能力均衡,适合日常使用 | √ 图片输入 √ 推理模型 |

| GLM-5.0-Turbo | 面向Agent场景进行了深度优化 | √ 图片输入 √ 推理模型 |

| GLM-5v-Turbo | 原生多模态模型 | √ 图片输入 √ 推理模型 |

| GLM-4.7 | 能力均衡,适合日常使用 | √ 图片输入 √ 推理模型 |

| MiniMax-M2.7 | 能力均衡,适合日常使用 | √ 图片输入 √ 推理模型 |

| MiniMax-M2.5 | 能力均衡,适合日常使用 | √ 图片输入 √ 推理模型 |

| Kimi-K2.5 | 多模态模型,适合日常任务 | √ 图片输入 √ 推理模型 |

| DeepSeek-V3.2 | 能力均衡,适合日常使用 | √ 图片输入 √ 推理模型 |

| Hunyuan-2.0-Thinking | 能力均衡,适合日常使用 | √ 推理模型 |

| GLM-5.1 | 能力均衡,适合日常使用 | √ 图片输入 √ 推理模型 |

| Kimi-K2.6 | 多模态模型,适合日常任务 | √ 图片输入 √ 推理模型 |

自定义模型

- 模型列表:已配置的自定义模型以列表形式展示,每条记录显示模型名称与供应商图标。

- 添加 / 编辑 / 删除:支持通过弹窗操作完成全部增删改流程。

- 对话入口联动:对话界面的模型选择器展示自定义模型分组,并支持快捷跳转到配置界面进行编辑。

在设置页模型中可以通过图形界面管理自定义模型,无需操作配置文件:

配置在保存后自动持久化,选择标准供应商时,工具调用、图片输入等能力标记会自动写入,无需手动配置。

TIP

已通过 ~/.codebuddy/models.json 配置的自定义模型在界面升级后仍可正常使用,并可通过 UI 界面查看、编辑或删除,无需再直接操作配置文件。

接入方式

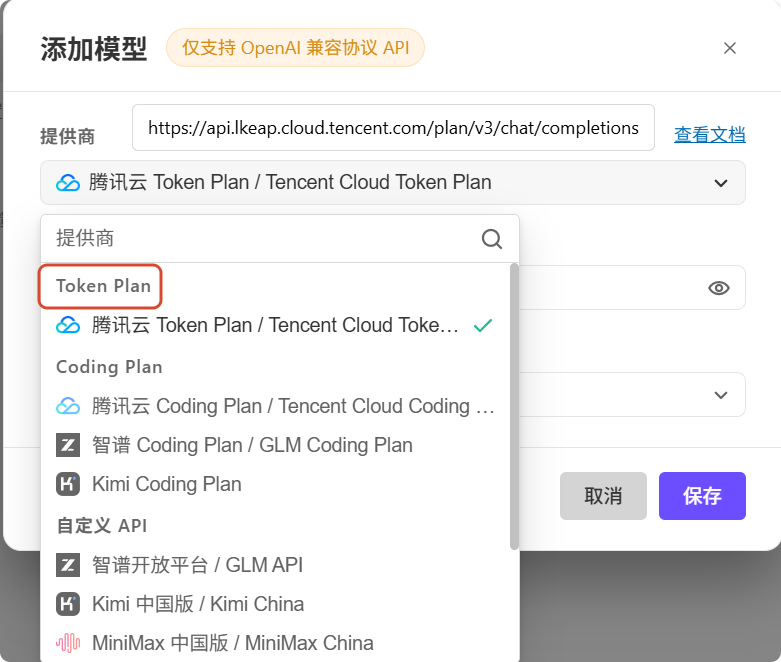

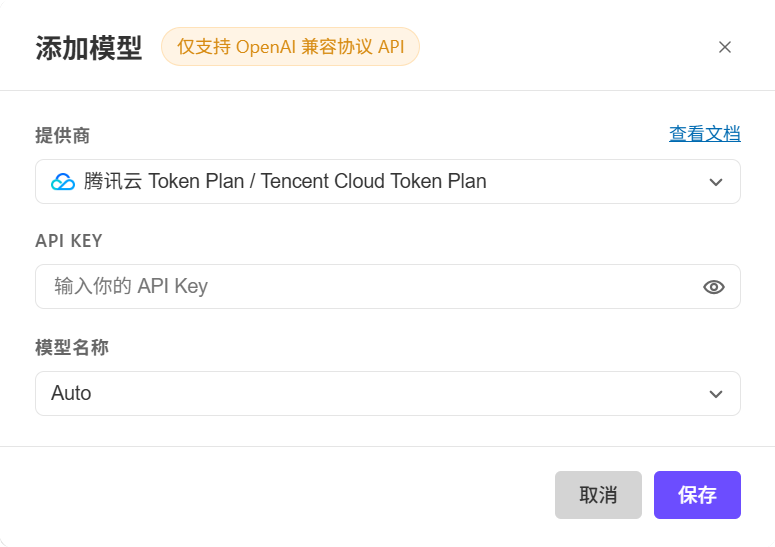

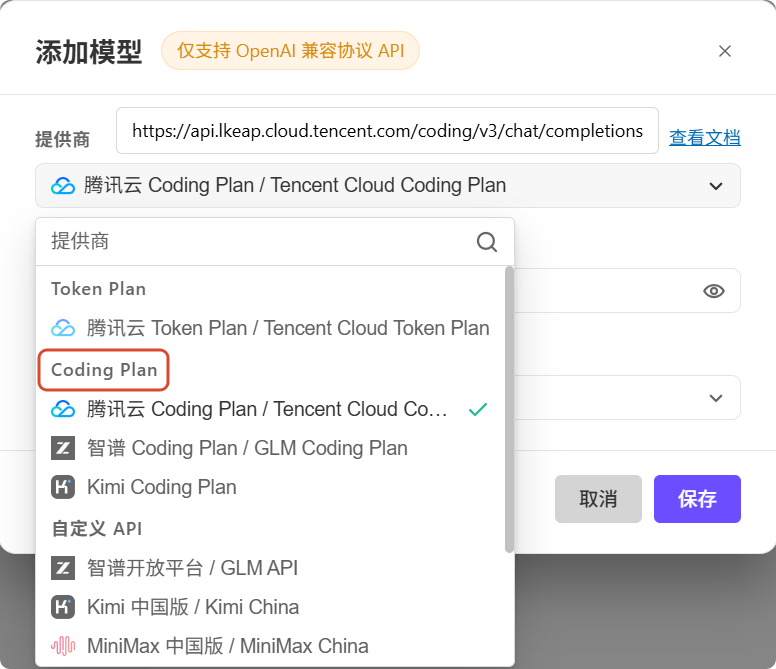

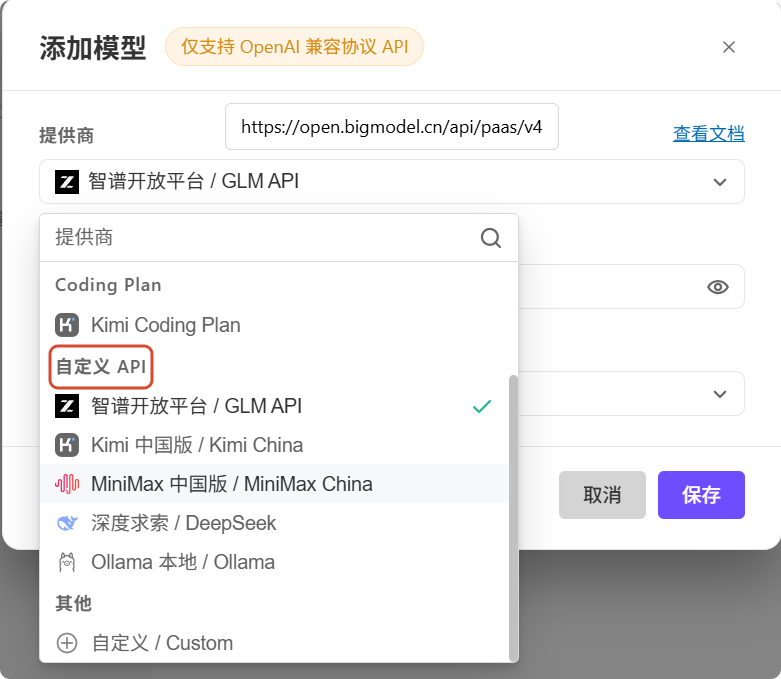

提供商接入

从提供商列表中选择或选择自定义API后,URL、模型列表、能力标记(工具调用、图片输入、推理模式等)会自动填充,仅需补全 API Key 即可保存使用,全程无需手动修改任何配置文件。

- Token Plan

需要按 Token 用量计费的团队,可在自定义模型配置中选择腾讯云 Token Plan 作为鉴权方式,支持混元、MiniMax、Kimi 等多款主流模型。

自定义模型设置中选择腾讯云 Token Plan 作为提供商选项,支持以腾讯云账号体系完成鉴权与计费。可接入的模型范围包括混元 2.0、MiniMax、Kimi、GLM 等。

- Coding Plan

Coding Plan是为 AI Coding 场景推出的专属订阅套餐,支持接入腾讯云Coding Plan、智谱Coding Plan和Kimi Coding Plan。

- 自定义API

内置了主流厂商的预设入口,可一键完成接入:

本地部署

Ollama 是一个开源的本地大模型运行工具,安装后通过一行命令即可拉取并运行开源模型。Ollama 启动后会在本地监听 HTTP 端口(默认 11434),并自动提供兼容 OpenAI 协议的接口供WorkBuddy对接。

适用场景:

- 数据隐私 / 内网合规:代码与对话内容不出本机,适合金融、政企、敏感项目场景。

- 零成本试用:不用消耗 Token、不用付费 API Key,把硬件当算力。

- 离线可用:飞机上、内网开发机、没网的环境也能用 WorkBuddy。

自定义

如果你的模型服务不在上方列表中,可选择自定义/Custom,手动填写 URL、API Key 与模型名接入。

自定义协议

当模型服务使用非标准 URL 路径(如经过网关或代理层封装)时,可在高级配置中开启自定义协议开关。开启后 WorkBuddy将直接按填写的 URL 发起请求,跳过路径校验与自动补全。

| 状态 | 行为 |

|---|---|

| 关闭(默认) | 使用标准 /chat/completions 路径,自动校验并补全接口地址 |

| 开启 | 直接使用用户填写的接口地址发起请求,跳过路径校验与自动补全逻辑 |